Dans les bureaux français, une révolution silencieuse est en marche. Selon une étude IFOP-Talan 2023, 68% des employés français utilisant des outils d’intelligence artificielle ne le déclarent pas à leur hiérarchie. Plus alarmant encore, près de 50% des collaborateurs se tournent vers des outils d’IA non approuvés pour accomplir leurs tâches, d’après le rapport Zendesk 2025. Ce phénomène, baptisé « Shadow IA », représente aujourd’hui l’une des menaces les plus sous-estimées pour la cybersécurité des organisations.

Pour les dirigeants, DSI et RSSI, comprendre et maîtriser le Shadow IA devient une priorité absolue. Les conséquences financières se chiffrent en centaines de milliers d’euros : selon le rapport IBM 2025, le Shadow IA alourdit en moyenne de 321 900 euros le coût d’une violation de données en France. Au-delà des aspects financiers, ce phénomène soulève des enjeux critiques de conformité réglementaire cybersécurité, de gouvernance cybersécurité et d’éthique IA. Découvrons ensemble comment identifier, comprendre et maîtriser cette menace émergente.

Comprendre le Shadow IA : anatomie d’un phénomène massif

Définition et ampleur du Shadow IA

Le Shadow IA désigne l’utilisation par les collaborateurs d’outils d’intelligence artificielle (chatbots, générateurs de code ou de contenus, solutions cloud externes) sans validation de la direction des systèmes d’information ni intégration dans les processus de sécurité. Autrement dit, une IA qui opère en marge des politiques officielles de l’entreprise.

Ce phénomène s’inscrit dans la continuité du Shadow IT traditionnel, mais présente des caractéristiques qui le rendent particulièrement préoccupant. Contrairement aux applications non autorisées classiques, les outils d’IA générative traitent directement des contenus sensibles : rapports stratégiques, codes sources, données clients, informations confidentielles.

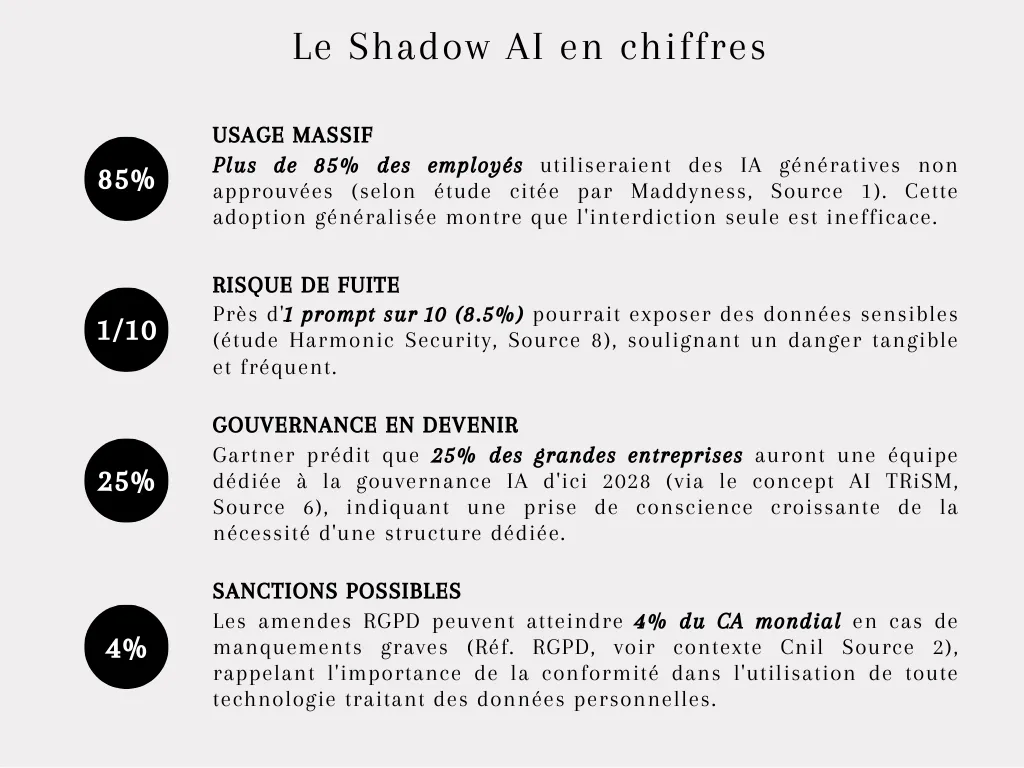

Dans certains secteurs particulièrement exposés comme les services financiers, l’utilisation du Shadow IA a littéralement explosé, enregistrant une hausse de 250% en un an. Et ce n’est pas un phénomène ponctuel : 93% des agents ayant recours à ces outils les utilisent régulièrement, créant une dépendance opérationnelle préoccupante.

Les motivations derrière l’adoption sauvage

Comprendre pourquoi les collaborateurs se tournent vers le Shadow IA permet de mieux appréhender le phénomène et d’y apporter des réponses adaptées.

• La quête d’efficacité : les employés cherchent à améliorer leur productivité face à des charges de travail croissantes.

• Le retard des solutions internes : comme l’explique Michel Cazenave, CISO chez PwC, « le Shadow IT, c’est le nom que l’on donne à l’inventivité des utilisateurs pour trouver des solutions quand on ne leur en fournit pas ».

• L’accessibilité des outils : de nombreuses IA sont disponibles en ligne gratuitement ou via des abonnements personnels. Quelques clics suffisent pour accéder à des capacités puissantes, sans attendre une validation qui peut prendre des semaines ou des mois.

• La méconnaissance des risques : beaucoup de collaborateurs n’ont pas conscience des implications sécuritaires et réglementaires de leurs usages. Ils perçoivent ces outils comme de simples assistants.

Cette compréhension des motivations est essentielle pour construire une réponse adaptée qui ne se limite pas à l’interdiction mais propose des alternatives viables.

Les risques multidimensionnels du Shadow IA

Exposition des données sensibles et fuites d’information

Le premier risque, et le plus critique, concerne la sécurité des données. Lorsque des collaborateurs utilisent des outils IA externes pour traiter des informations internes, ces données peuvent être stockées sur des serveurs tiers, souvent situés hors d’Europe, sans garantie de confidentialité ni de suppression.

Les cas concrets illustrent la gravité de ces risques. Samsung a dû interdire l’usage d’une IA mondialement connue après que des employés ont involontairement divulgué des informations confidentielles, incluant du code source propriétaire et des données stratégiques.

Selon le rapport IBM 2025 sur le coût des violations de données, les entreprises avec un niveau élevé de Shadow IA voient leurs coûts augmenter de 670 000 dollars par rapport à celles qui en ont peu ou pas. Plus alarmant encore, 20% des violations de données mondiales impliquent désormais des systèmes de Shadow IA.

L’audit cybersécurité révèle souvent des angles morts considérables : les équipes de sécurité ne peuvent protéger ce qu’elles ne voient pas. Le Shadow IA multiplie ces zones d’ombre, rendant les évaluations de maturité cybersécurité partielles et trompeuses.

Non-conformité réglementaire et risques juridiques

L’usage non encadré de l’IA expose directement l’entreprise à des risques de non-conformité aux réglementations en vigueur, avec des conséquences financières et réputationnelles majeures.

Violations RGPD : le traitement de données personnelles via des outils non approuvés peut constituer une violation grave du RGPD. Les sanctions peuvent atteindre 4% du chiffre d’affaires mondial ou 20 millions d’euros.

Non-conformité NIS2 : la directive Network and Information Security 2 impose aux opérateurs essentiels et importants une maîtrise stricte de leur chaîne d’approvisionnement numérique et de leurs traitements de données. Le Shadow IA crée des dépendances non documentées et non sécurisées, incompatibles avec ces exigences.

Obligations AI Act : l’obligation de formation à l’IA prévue par l’article 4 de l’AI Act est en vigueur depuis février 2025. Selon la FAQ de la Commission européenne de mai 2025, un programme de formation adapté doit couvrir la culture générale sur l’IA, le rôle de l’entreprise, les risques spécifiques et les cas d’usage. Le Shadow IA échappe totalement à ce cadre.

Secteurs régulés : les secteurs hautement régulés comme la santé, la finance et les services juridiques sont particulièrement vulnérables. Dans ces domaines, l’utilisation de Shadow IA a augmenté de plus de 200% en un an.

Au-delà des sanctions financières directes, 13% des leaders IT rapportent avoir subi des dommages financiers, clients ou réputationnels suite à des incidents liés au Shadow IA. L’impact réputationnel peut s’avérer dévastateur et durable.

Vulnérabilités techniques et cyberattaques

Le Shadow IA élargit considérablement la surface d’attaque de l’entreprise. Chaque outil non validé constitue une porte d’entrée potentielle pour les cybercriminels, qui adaptent leurs techniques à cette nouvelle réalité. Les résultats peuvent être les suivants :

• Code source compromis (Copié sur une IA dans un cadre d’amélioration qui se retourne contre le développeur)

• Prompt injection et exfiltration : les modèles LLM déployés peuvent être la cible d’attaques de prompt injection permettant d’extraire des informations sensibles.

• Phishing et ingénierie sociale : l’IA générative est devenue la machine d’ingénierie sociale du cybercriminel.

Stratégies de détection et de maîtrise du Shadow IA

• Identifier les usages non autorisés dans votre organisation (Analyse des flux réseau, audits des postes de travail, enquêtes et questionnaires anonymes, analyse des productions, revue de sécurité informatique approfondie)

• Construire une gouvernance IA robuste (Définir une politique d’usage claire, établir un comité de gouvernance IA, implémenter des processus de validation rapides (-15 jours), documenter et tracer, intégrer dans le contrôle interne sécurité).

• Proposer des alternatives sécurisées et performantes (Déployer une IA souveraine interne, proposer une plateforme d’IA encadrée, développer des assistants métiers spécialisés, simplifier l’accès aux outils validés…)

L’évaluation de la maturité cybersécurité doit désormais intégrer explicitement la dimension Shadow IA, avec des indicateurs spécifiques de visibilité et de maîtrise, le plan d’action cybersécurité doit intégrer explicitement le déploiement de ces alternatives comme priorité stratégique, avec des ressources et des échéances claires.

• Former, sensibiliser et accompagner le changement (Formation générale à l’IA, sensibilisation aux risques, formation aux outils autorisés)

L’obligation de formation prévue par l’AI Act renforce la nécessité de ces programmes, transformant une bonne pratique en obligation réglementaire.

• Créer une culture de responsabilité et de transparence (Communication descendante claire, encourager le signalement (sans risque de sanctions), reconnaître l’innovation, responsabilisation éthique, retours d’expérience partagés).

Au-delà de la formation technique, développer une culture organisationnelle où chacun se sent responsable et libre de s’exprimer sur ses besoins et pratiques.

Conclusion : Transformer une menace en opportunité stratégique

Le Shadow IA représente aujourd’hui l’une des menaces les plus sous-estimées pour la cybersécurité des organisations. Avec 68% des utilisateurs français d’IA ne déclarant pas leurs usages, près de 50% des collaborateurs recourant à des outils non approuvés, et des coûts supplémentaires de plus de 320 000 euros par violation de données, l’ampleur et l’impact du phénomène ne peuvent plus être ignorés.

Pour les dirigeants, DSI et RSSI, la réponse ne peut se limiter à l’interdiction. Le Shadow IA révèle une inadéquation entre les besoins opérationnels des collaborateurs et les solutions proposées par l’organisation. Construire une gouvernance cybersécurité efficace nécessite de reconnaître cette réalité et d’y apporter des réponses pragmatiques.

La maîtrise du Shadow IA s’inscrit dans une démarche plus large de transformation numérique responsable, intégrant les bonnes pratiques gouvernance IT, le respect de la conformité réglementaire cybersécurité (RGPD, NIS2, AI Act) et les principes d’éthique IA. Les organisations qui réussiront cette transformation transformeront une menace en opportunité.

DYNATRUST a intégré sa propre IA souveraine dans sa plateforme, qui ne prend ses sources d’aucune IA existante. Cette solution garantit une maîtrise totale de vos données, une conformité RGPD native et une indépendance technologique complète.

Votre organisation est-elle exposée au Shadow IA sans le savoir ? Nos experts en gouvernance cybersécurité vous accompagnent dans l’évaluation de votre maturité cybersécurité. Contactez nous pour réaliser un audit informatique entreprise complet et élaborer un plan d’action cybersécurité transformant cette menace en avantage concurrentiel.

Bénéficiez de notre expertise en conformité réglementaire cybersécurité et éthique IA pour accélérer votre transformation digitale responsable et renforcer votre position de leader sur votre marché.